chatgpt中文版 http://chatgpt.guige.xyz

MLNLP社区是国内外知名的机器学习与自然语言处理社区,受众覆盖国内外NLP硕博生、高校老师和企业研究人员。

社区的愿景是增进国内外自然语言处理,机器学习学术界、产业界和广大爱好者之间的交换和进步,特别是初学者同学们的进步。在各个AI、科技公司纷纭投入大模型的今天,OpenAI已成了各家争相比较的对象,每一个大模型发布的时候都不可避免地要拿来和ChatGPT对照。例如说,某头部企业发布大模型时宣称自己和ChatGPT的差距只有一两个月,但也有友商认为该企业多是活在平行世界,差距应当是三年;OpenAI之所以难以追逐,是由于他们不止在技术上领先于其他竞争对手一个周期,就连目前在做的事情和理念也领先了竞争对手一个周期,比如说用AI解释AI,用黑盒解释黑盒。就在刚刚过去的本周二,OpenAI又公布了一项重量级研究成果:用GPT⑷解释GPT⑵的神经元行动,引发全球吃瓜大众啧啧称奇的同时也不免让人心生好奇,AI不是人类发明的吗,为何现在需要用AI来解读AI?OpenAI本周二在官网发布博客文章《语言模型可以解释语言模型中的神经元》(Language models can explain neurons in language models),就表示:“我们使用GPT⑷自动编写大型语言模型中神经元行动的解释,并为这些解释评分。我们发布了GPT⑵中每一个神经元的这些(不完善的)解释和分数的数据集。”一篇论文发布,本来不值得称奇;但读过这篇论文的人,却大多不免被OpenAI的奇思异想震动,头皮发麻。打从ChatGPT横扫科技圈的那天,就一直有人提问:“到了今天这一步,AI是怎样实现这么强大的功能的?”为了回答这个问题,OpenAI的做法可以简单的概括为“用黑盒解释黑盒”。而且OpenAI的这次研究成果,倒也不失为后续AI与大模型等相关企业进行研究探索了新的方向,自然意义非凡。此次对神经元的解释恰如当年的科研工程“人类基因组计划”,辨识基因及其序列对医学,生物学,乃至全部生命科学都产生难以估计的深远影响,实现了破译人类遗传信息的终纵目的,而对每一个神经元的解释也意味着人类在破解AI奥秘的漫漫长路上又前进了一步。研究的起因

自去年11月ChatGPT上线以来,大语言模型(LLM)就引发了普遍关注,引发关于AI伦理与治理的耽忧也日趋的水长船高:“LLM等大模型的能力愈来愈强,部署和利用的也愈来愈广泛,但对其内部工作方式的理解,我们依然知之甚少。”由于大模型自带“黑盒”性质,外界很难分辨它们的输出结果会不会采取了带有某种见不得人的方法,AI幻觉难以根治,“一本正经的胡说八道”也常常致使使人啼笑皆非,哭笑不得的结果,因此了解黑盒内部的工作方式,特别是黑盒的“可解释性”是迫切需要解决的一个重要问题。通常说来,AI的工作方式可以视为对人类大脑工作方式的逆应用与模仿。而黑盒也在结构上模仿大脑,由海量的神经元组成。比如ChatGPT就是在学习文本的同时视察其中的规律,和这些规律如何影响终究的结果。因此要想说明“可解释性”就要先了解每一个神经元在做甚么。从AI的角度来讲,每一个神经元都代表着区别的数据和与之相关的特点,如果神经元数量有限也许可以用人力完成,但是如今大模型的神经网络包括的参数动辄百亿千亿,而且还在不断进化发展,再依托人力明显是痴人说梦。那末OpenAI用GPT⑷解释GPT⑵的神经元行动也就不难理解了,对此官方表示“我们用GPT⑷为GPT⑵中的神经元行动自动编写解释,并为这些解释打分。”GPT⑵首发于2019年2月,神经元约30万个,参数量约15亿。实际表现与引发的反响

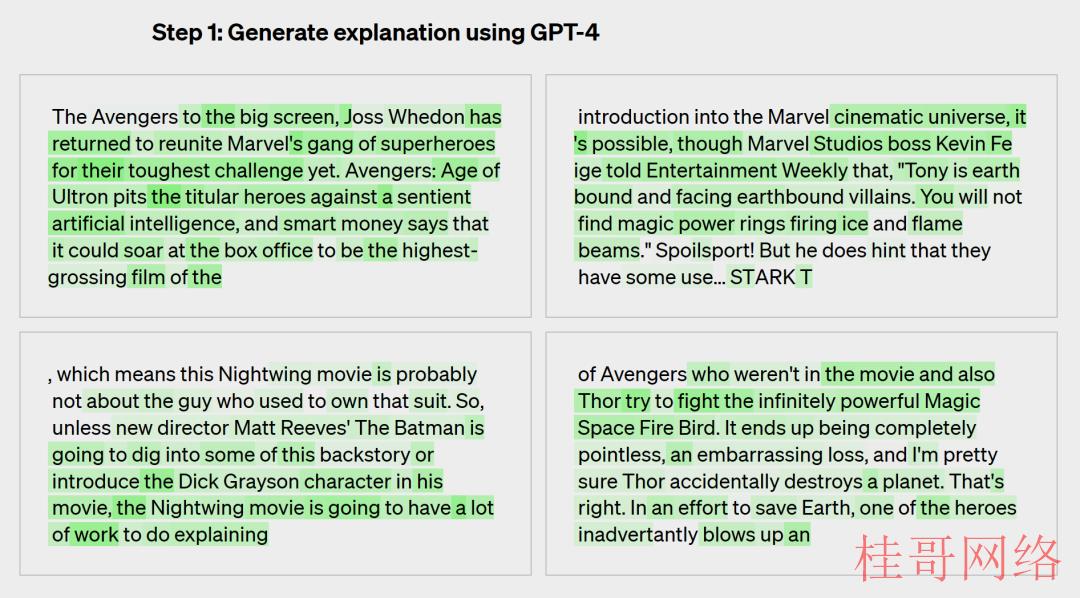

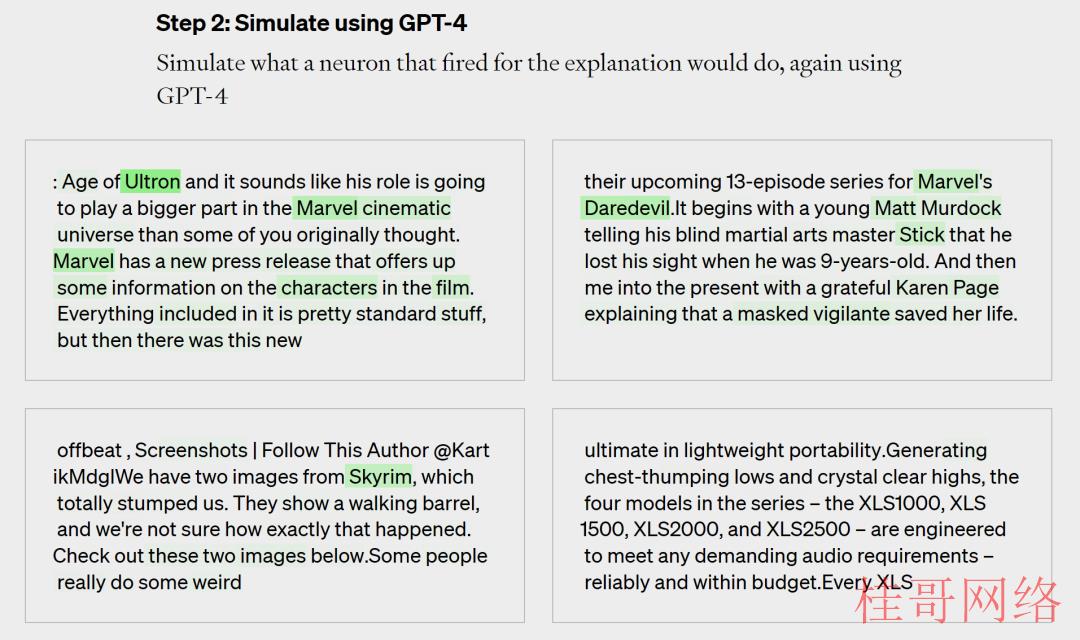

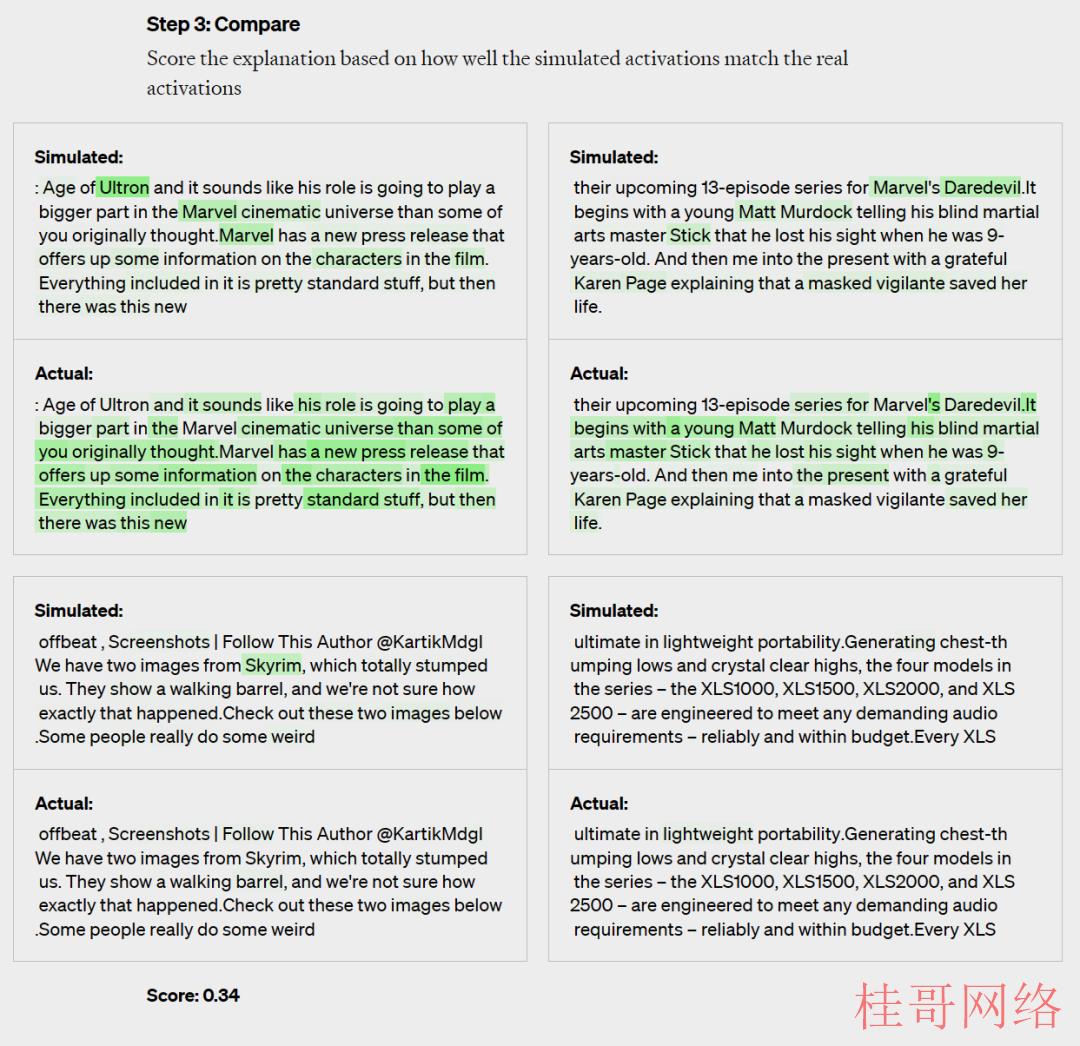

1.给GPT⑷一个GPT⑵已有的神经元,由GPT⑷展现相关的文本序列和激活情况,产生一个对此类行动的解释;2.再次使用GPT⑷,摹拟被解释的神经元会做甚么;3.比较两者的结果,根据匹配程度对GPT⑷的解释进行评分。虽然OpenAI官方表示GPT⑷解释了GPT⑵中的约30万个神经元,但是绝大多数的实际得分都偏低。只有委曲一千多个的得分高于0.8,这意味着神经元的大部份顶级激活行动都是这一千多个神经元引发的。看来AI也许也在成心无意间遵守“二八定律”。另外OpenAI官方还表示,他们这次采取的方法局限性很大,未来需要逐渐攻克,比如:2.GPT⑷给出的解释普遍简短,但神经元都有着非常复杂的行动,不可能用简单的语言就描写清楚;3.GPT⑷只解释了神经元的行动,而没有解释驱动行动背后的机制,而机制部份明显更成心义;4.这类方法的确解释了神经元的行动,但没有触及下游影响,希望终究能实现流程的自动化,并解释能实现复杂行动的全部神经回路。对OpenAI公布的研究成果,很快在全球各大技术平台也引发了广泛关注。有人批评其得分甚低:“对GPT⑵的解释尚且如此,那如何了解GPT⑶和GPT⑷内部结构呢?但这才是许多人现在更关注的答案。”也有人感慨AI进化的方式愈发先进:“未来就是用AI完善AI模型,会加速进化。”还有人担心AI进化的未来:“再弄下去,AI真的要觉醒了?”启发

人的大脑,其实就是神经元组成的网络。从计算机的角度上来说,它的结构十分低效——它没有存储装备,神经元的通讯也是通过化学的方式来进行,相当的别扭。用这类“落后”的“元器件”,居然能给人类如此高的智慧,说明人脑的强大,强在架构。如前所述,AI可以视为对大脑运转的模仿,而探索生命模型也是脑科学研究的中心任务之一,是探索人类本身、解密思惟与智能成因的科学探索需要。脑科学与AI息息相关,既可以提升我们人类对本身奥秘的理解,也能够改良对脑部疾病的认知水平,同时相关科研成果也能够为发展类脑计算,突破传统电脑架构的束缚提供根据。而相信“类脑计算”才是AI未来的,OpenAI其实不是唯一家。北京大学信息科学技术学院教授,计算机科学技术系系主任,北京智源研究院院长——黄铁军教授,就致力于摹拟出类似人类的神经网络系统,并培养出AI的可进化能力。利用类脑计算技术,黄铁军和他的“天演”团队创造了一个高精度摹拟的娟秀线虫,其中302个相互连接的神经元、嗅觉和运动神经环路都被还原,展现出了生物神经元计算的巨大潜力。但在当下,类脑计算还具有着巨大的空间,等待着科研气力弥补——当下千亿量级参数的大模型,如果把参数看成神经的突触,大模型对应人脑的神经元,只有1亿个。而1亿个神经元,这与人脑千亿级别的神经元,中间还差了1000倍的差距,而这也许也是走向AGI,人类科学一定要逾越的鸿沟。而OpenAI新近发表的这篇论文,也在无形中,给了人类科学技术的进步,展现了一种可能性:当未来人工智能变得越发强大,乃至有一天超出人类,它也能在后续更多的前沿科技上,为人类提供帮助;而对智能的研究,在生物大脑以外,也有了AI系统作为新的研究对象,这也为破解智能之谜带来了新的希望。

扫描二维码添加小助手微信

便可申请加入自然语言处理/Pytorch等技术交换群关于我们

MLNLP 社区是由国内外机器学习与自然语言处理学者联合构建的民间学术社区,目前已发展为国内外知名的机器学习与自然语言处理社区,旨在增进机器学习,自然语言处理学术界、产业界和广大爱好者之间的进步。社区可以为相关从业者的进修、就业及研究等方面提供开放交换平台。欢迎大家关注和加入我们。

桂!哥!网!络www.guIgEGe.cn

TikTok千粉账号购买:https://www.tiktokfensi.com/

本文来源于chatgptplus账号购买平台,转载请注明出处:https://chatgpt.guigege.cn/jiaocheng/29782.html 咨询请加VX:muhuanidc